Darwin entre las Máquinas, de Butler, advertía de una futura raza mecánica que podría subyugar a la humanidad.

Aunque preocuparse por la dominación de la IA pueda parecer una idea moderna surgida de Juegos de guerra o Terminator, resulta que una preocupación similar sobre el dominio de las máquinas se remonta a la época de la Guerra Civil estadounidense, aunque por parte de un ganadero de ovejas inglés que vivía en Nueva Zelanda. En teoría, Abraham Lincoln podría haber leído algo sobre la dominación de la IA durante su vida.

El 13 de junio de 1863, una carta publicada en el periódico The Press de Christchurch advertía de los peligros potenciales de la evolución mecánica y llamaba a la destrucción de las máquinas, presagiando el desarrollo de lo que hoy llamamos inteligencia artificial, y la reacción en su contra de quienes temen que pueda amenazar a la humanidad con la extinción. Presentaba lo que podría ser el primer argumento publicado a favor de detener el progreso tecnológico para evitar que las máquinas dominen a la humanidad.

Titulada «Darwin entre las Máquinas», la carta ha vuelto a aparecer recientemente en las redes sociales gracias a Peter Wildeford, del Institute for AI Policy and Strategy. El autor de la carta, Samuel Butler, la envió bajo el seudónimo de Cellarius, pero más tarde asumió públicamente su postura. La carta establecía un paralelismo directo entre la teoría de la evolución de Charles Darwin y el rápido desarrollo de la maquinaria, sugiriendo que las máquinas podrían desarrollar la conciencia y acabar suplantando a los humanos como especie dominante de la Tierra.

«Nosotros mismos estamos creando a nuestros propios sucesores», escribió. «Cada día aumentamos la belleza y la delicadeza de su organización física; cada día les damos más potencia y les proporcionamos, mediante toda clase de ingeniosos artificios, ese poder autorregulador y autoactivo que será para ellos lo que el intelecto ha sido para la raza humana. En el transcurso de los siglos nos descubriremos como la raza inferior».

En la carta, también describía a los humanos como subordinados de las máquinas, pero primero como cuidadores que mantendrían y ayudarían a reproducir la vida mecánica, una relación que Butler comparó con la que existe entre los humanos y sus animales domésticos, antes de que más tarde se invierta y las máquinas tomen el control.

«Entendemos que cuando llegue el estado de cosas que hemos intentado describir más arriba, el hombre se habrá convertido para la máquina en lo que el caballo y el perro son para el hombre... les damos lo que la experiencia nos enseña que es mejor para ellos... del mismo modo, es razonable suponer que las máquinas nos tratarán amablemente, ya que su existencia depende de la nuestra tanto como la nuestra de los animales inferiores», escribió.

El texto anticipaba varias preocupaciones modernas sobre la seguridad de la IA, como la posibilidad de la conciencia de las máquinas, la autorreplicación y la pérdida de control de los humanos sobre sus creaciones tecnológicas. Estos temas aparecieron más tarde en obras como El Conflicto Evitable de Isaac Asimov, las novelas Dune de Frank Herbert (Butler posiblemente sirvió de inspiración para el término «Yihad Butleriana») y las películas Matrix.

La carta de Butler ahondaba en la taxonomía de la evolución de las máquinas, analizando los «géneros y subgéneros» mecánicos y señalando ejemplos como la evolución de los relojes a partir de los «toscos relojes del siglo XIII», sugiriendo que, al igual que algunos vertebrados primitivos, las especies mecánicas podrían volverse más pequeñas a medida que se volvían más sofisticadas. Amplió estas ideas en su novela de 1872 Erewhon, que describía una sociedad que había prohibido la mayoría de los inventos mecánicos. En su sociedad ficticia, los ciudadanos destruían todas las máquinas inventadas en los 300 años anteriores.

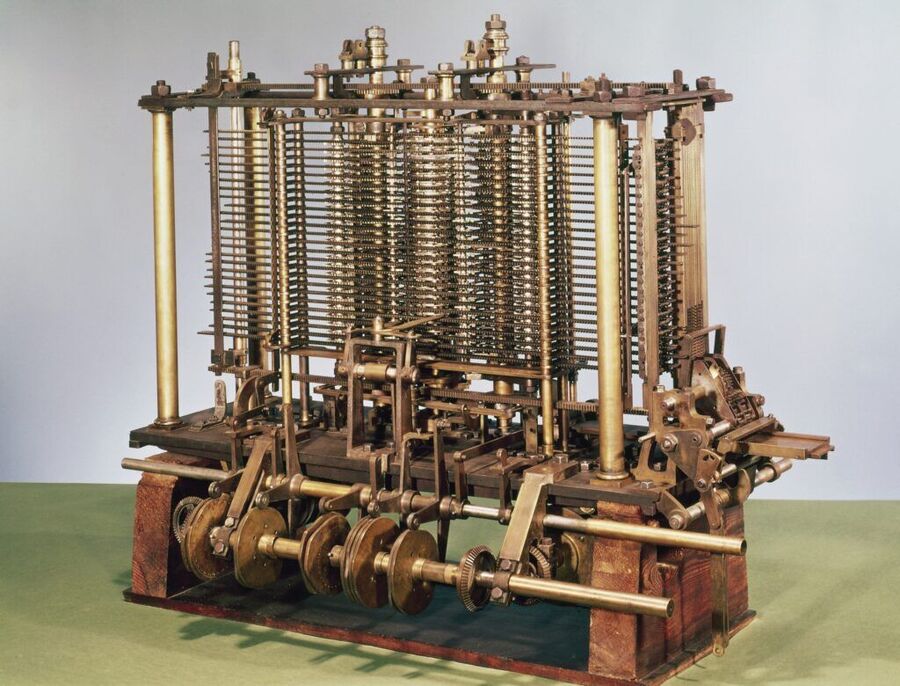

Lo que hace especialmente notable la visión de Butler es que escribía en un contexto tecnológico muy diferente, cuando apenas existían los dispositivos informáticos. Mientras que Charles Babbage había propuesto su teórica Máquina Analítica en 1837 -un ordenador mecánico que utilizaba engranajes y palancas y que no llegó a construirse en vida del científico-, los dispositivos de cálculo más avanzados de 1863 eran poco más que calculadoras mecánicas y reglas de cálculo.

Butler extrapoló a partir de las máquinas simples de la Revolución Industrial, donde la automatización mecánica estaba transformando la fabricación, pero no existía nada parecido a los ordenadores modernos. El primer ordenador operativo controlado por programa no aparecería hasta 70 años después, lo que hace que sus predicciones sobre la inteligencia de las máquinas sean sorprendentemente premonitorias.

Algunas cosas nunca cambian

El debate que inició Butler continúa hoy. Hace dos años, el mundo se enfrentaba a lo que podríamos llamar el «gran susto de la toma del poder de la IA en 2023». El GPT-4 de OpenAI acababa de salir al mercado, y los investigadores evaluaron su «comportamiento de búsqueda de poder», haciéndose eco de las preocupaciones sobre la posible autorreplicación y la toma de decisiones autónoma.

El lanzamiento de GPT-4 inspiró varias cartas abiertas firmadas por investigadores de IA y ejecutivos tecnológicos que advertían de los riesgos potenciales de extinción que plantea la inteligencia artificial avanzada. Una de las cartas, que recuerda a los temores sobre las armas nucleares o las pandemias, pedía una pausa mundial en el desarrollo de la IA. Por la misma época, Sam Altman, director ejecutivo de OpenAI, testificó sobre los peligros de la IA ante el Senado de Estados Unidos.

Un año más tarde, el legislador californiano Scott Wiener propuso un proyecto de ley para regular la IA, respaldado por destacadas figuras que los críticos tacharon de «catastrofistas de la IA», es decir, aquellos que temían la progresión incontrolada de la inteligencia de las máquinas. Quienes se oponían al proyecto de ley argumentaban que esas medidas eran exageradas y podían ahogar la innovación, como había hecho la sociedad ficticia de Butler. Sin embargo, su llamamiento del siglo XIX a detener el progreso mecánico se parece mucho a las recientes cartas abiertas y propuestas políticas sobre la seguridad de la IA.

Quizá el gran susto de la toma de control por parte de la IA se vea algún día como un capítulo más de la larga lucha de la humanidad por conciliar el progreso con una supervisión humana adecuada, una lucha que Butler presagió hace más de 160 años. Pero, en cierto modo, aunque las máquinas nunca lleguen a ser verdaderamente inteligentes, Butler fue inquietantemente certero sobre nuestra dependencia de la forma en que regulan algorítmicamente nuestras vidas.

«Día a día, sin embargo, las máquinas nos ganan terreno; día a día nos volvemos más sumisos a ellas», escribió Butler en 1863.

«El resultado es simplemente una cuestión de tiempo, pero que llegará el momento en que las máquinas tendrán la supremacía real sobre el mundo y sus habitantes es algo que ninguna persona de mente verdaderamente filosófica puede poner en duda ni por un momento.»Butler no terminó su carta con una aceptación pasiva de este destino. De forma parecida a la propuesta de Eliezer Yudkowsky de 2023 de bombardear los centros de datos para evitar la toma del poder por parte de la IA, la carta de Butler concluía con una dramática llamada a las armas: «Debería proclamarse inmediatamente la guerra a muerte contra ellas. Toda máquina de cualquier tipo debería ser destruida por el bienhechor de su especie. No hagamos excepciones, no demos cuartel; volvamos de inmediato a la condición primitiva de la raza».

Incluso entonces, temía que ya fuera demasiado tarde, escribiendo que si tal destrucción resultaba imposible debido a nuestra creciente dependencia de ellas:

«Esto demuestra de inmediato que el mal ya está hecho, que nuestra servidumbre ha comenzado en serio, que hemos creado una raza de seres que está más allá de nuestro poder destruir».

Comentarios del Lector

a nuestro Boletín